¿Es la IA suficientemente inteligente para satisfacer las necesidades de las comunidades vulnerables?

Los avances de la Inteligencia Artificial al servicio del desarrollo

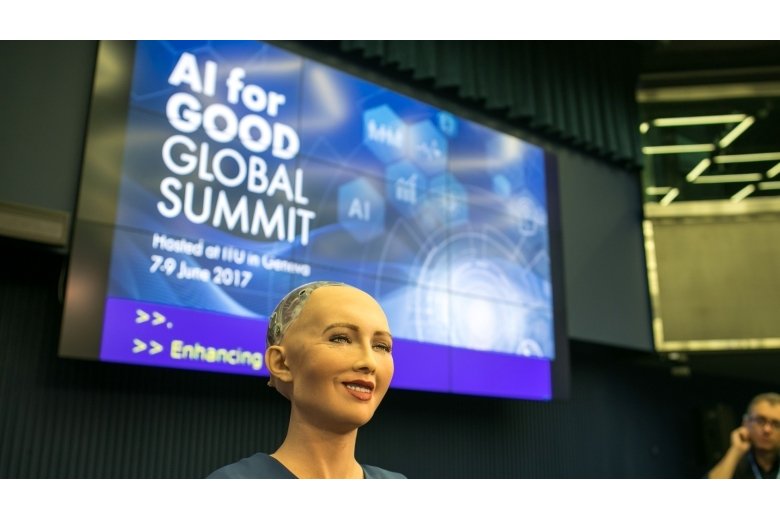

Sophia, Hanson Robotics Ltd., hablando en la AI for Good Global Summit, UIT, Ginebra, Suiza, 7-9 de junio de 2017. © UIT/R.Farrell

Por Rabi Thapa

La presentación pública a finales de 2022 de ChatGPT, el chatbot de la IA generativa de OpenAI, provocó un frenesí en los medios de comunicación con respecto al vertiginoso desarrollo de la inteligencia artificial y lo que esta significa para el futuro de la raza humana y el planeta en general. Durante la reciente Cumbre Digital Mundial (i), el presidente del Banco Mundial, Ajay Banga, señaló que “hasta las personas con una actitud relativamente ingenua hacia la IA están yendo a toda prisa hacia ella, por miedo a quedarse atrás”.

La IA no es nueva: numerosos sectores del desarrollo ya la están utilizando. Sin embargo, su evolución para pasar de sistemas basados en parámetros rígidos del tipo causa-consecuencia a sistemas de aprendizaje automático “profundo” que emulan las redes neuronales humanas ha sido extraordinaria. El debate en torno a las ventajas y las desventajas de la IA ha dado lugar a la aprobación acelerada de normas para regular su uso, y se han celebrado innumerables conferencias sobre las nuevas tecnologías.

Con todo, y pese a la noción de que la IA es omnipresente, es necesario dejar claro un hecho fundamental sobre la brecha digital. Casi la mitad de la población del mundo carece de acceso a Internet, y alrededor de 800 millones de personas no acceden a la electricidad, en su mayoría en las regiones donde se centran las iniciativas de desarrollo. Dada la rapidez de la innovación y la adopción de la IA en el hemisferio norte, es probable que observemos una “brecha de IA” aún mayor en los países donde todavía no existen los elementos fundamentales de la economía digital. Entonces, ¿cuál es el panorama actual en torno a la IA en el campo del desarrollo, y cómo incide en las comunidades vulnerables que podrían verse perjudicadas por proyectos de desarrollo?

¿Hacia dónde vamos?

Es indudable que la IA representa un monto enorme: en un informe (i) de 2017 de PwC Global, se estimó que esta tecnología podría añadir USD 15,7 billones a la economía mundial de aquí al 2030. Pero ¿quiénes se beneficiarían de este valor, y qué significa la revolución de la IA para la Agenda 2030? En realidad, muchos consideran que la IA será clave para la consecución de los Objetivos de Desarrollo Sostenible (ODS), que son congruentes con los dos objetivos del Grupo Banco Mundial de poner fin a la pobreza extrema e impulsar la prosperidad compartida.

Durante la presentación del Órgano Asesor de Alto Nivel de las Naciones Unidas sobre la Inteligencia Artificial (i), en octubre de 2023, el secretario general, António Guterres, dijo que la IA podría potenciar los avances hacia los ODS. Según investigaciones (i) del Instituto Real de Tecnología KTH, ubicado en Suecia, la IA al ayudar en la toma de decisiones, la predicción, la obtención de conocimientos y el reconocimiento de patrones, y el razonamiento lógico podría contribuir a alcanzar 134 de las 169 metas de los 17 ODS. Entre algunos ejemplos de beneficios demostrados de la IA figuran la agricultura de precisión, los diagnósticos médicos, el apoyo docente y las tutorías virtuales, y el uso eficiente del agua y la energía.

Numerosos proyectos financiados por el Banco Mundial ponen de relieve los beneficios de la IA para las comunidades pobres. Por ejemplo, durante la pandemia de COVID-19, la elaboración de cartografías, los análisis geoespaciales y el aprendizaje automático ayudaron a evaluar el acceso de los beneficiarios a los servicios de protección social en Túnez. En Pakistán, el Banco utilizó la IA en el diseño de prototipos y desarrolló algoritmos para mejorar la gestión de préstamos habitacionales dirigidos a trabajadores del sector informal. La IA también se ha empleado en Nigeria para mejorar la supervisión de obras civiles y la participación ciudadana utilizando las nubes de palabras, la minería de opiniones y el análisis de sentimientos en la evaluación de respuestas enviadas a través de teléfonos móviles.

Ponerse al día

La brecha que está surgiendo en torno a la IA es un motivo de preocupación. Stela Mocan, gerente del Laboratorio de Tecnología e Innovación del Banco Mundial, que participó en los proyectos de IA en Pakistán y Túnez, señaló: “Existe un gran interés por parte de nuestros países miembros en aprovechar las tecnologías de IA, pero es necesario determinar si están listos con respecto a los datos, la infraestructura, las habilidades, los niveles de digitalización, y los marcos jurídicos y normativos. ¿Se puede implementar un proyecto de IA en el vacío?”.

Junto con el creciente nerviosismo que generan los riesgos de la IA relacionados con la seguridad, la desinformación, la privacidad, los derechos de autor, la ética y el empleo, también surge la cuestión de si las herramientas de IA, que en su mayoría se desarrollan en el hemisferio norte, son apropiadas para los países en desarrollo. La IA no hace más que reflejar los datos que se utilizan para alimentarla. Los algoritmos que se entrenan a partir de noticias que contienen prejuicios sociales contra las mujeres y las niñas replicarán esos sesgos y podrían limitar el logro del ODS 5 relativo a la igualdad de género, una situación que también podría afectar a todas las comunidades vulnerables y marginadas. De acuerdo con el informe del KTH, las nuevas tecnologías podrían impedir la consecución de 59 de las metas de los ODS. Por ejemplo, los equipos agrícolas mejorados con inteligencia artificial podrían no estar al alcance de los pequeños productores de los países en desarrollo, lo que incidiría de manera negativa en el ODS 2 (Hambre Cero).

En Filipinas, la ingeniera ambiental sénior Maya Villaluz, que utiliza herramientas de cartografía geoespacial mejoradas con IA para un importante programa agroindustrial, advirtió sobre los peligros de aplicar un enfoque único: “El Marco Ambiental y Social del Banco Mundial exige realizar evaluaciones del lugar y exámenes ambientales y sociales para cada actividad del subproyecto; esto genera una demanda de análisis, situación en la que la IA puede resultar útil. No obstante, para definir las necesidades reales de las personas en un país en desarrollo es necesario entender la diversidad de sus ecosistemas. Si no existen investigaciones previas y no hay datos de referencia, es importante aplicar criterios profesionales para verificar y validar los datos útiles a partir de un cúmulo de información aleatoria y no relacionada”.

La IA y los mecanismos de rendición de cuentas: ¿cuál es el potencial?

¿Cómo podría la IA contribuir a que los mecanismos independientes de rendición de cuentas beneficien a las comunidades? Esteban Tovar Cornejo, especialista social y ambiental del Mecanismo Independiente de Consulta e Investigación (MICI) del Banco Interamericano de Desarrollo (BID), explicó de qué manera el BID ha adoptado la IA al asociarse con Microsoft para optimizar el uso de su chatbot de generación de códigos, Co-Pilot. Una de las primeras tareas fue el uso de la IA para redactar en cuatro idiomas los términos de referencia de los nuevos funcionarios, una iniciativa que permitió ahorrar tiempo. Cornejo y su equipo también están experimentando con comandos de IA que ayuden al MICI a elaborar presentaciones de casos a partes interesadas: “Podemos pedirle a la herramienta de IA que se imagine que es un jefe de equipo de un proyecto del BID y que ha recibido una queja. ¿Qué información le resultaría útil a ese funcionario? Podemos asignar distintos roles en diversos sectores para entender mejor cómo trabajar con la gerencia del BID, la sociedad civil o los pueblos indígenas”. En el futuro, las partes interesadas externas quizás puedan recurrir a la IA para plantear las mismas preguntas e informarse mejor sobre los casos, posiblemente mediante una aplicación específica del MICI para teléfonos móviles.

El desafío radica en plantear las preguntas correctas y utilizar los datos correctos. Es aquí donde el enfoque progresivo del BID con relación a la IA, que se basa en su labor en torno a los macrodatos, proporciona un punto de partida al MICI. No obstante, la necesidad de velar por que los datos sean siempre de la mejor calidad implica que el equipo del MICI se sigue enfocando en la innovación y la eficiencia internas. Accountability Matters se contactó con otros representantes de mecanismos independientes de rendición de cuentas que señalaron que aunque están llevando adelante trabajos exploratorios en el área de la IA, aún es prematuro compartir conclusiones.

Los modelos de procesamiento del lenguaje natural podrían ofrecer una gama de opciones a estos mecanismos. Hace tiempo que las empresas se valen de chatbots automatizados para la tramitación de reclamaciones a gran escala. La automatización puede limitarse a recibir y dejar un registro de las quejas, pero una herramienta de IA puede buscar etiquetas clave y analizar el contenido emocional de los mensajes. Luego podría decidir si la reclamación en cuestión debe remitirse a un interlocutor humano. En el caso de los mecanismos independientes de rendición de cuentas que reciben reclamos complejos de miembros de la comunidad sobre los impactos de los proyectos, este uso de la IA está repleto de riesgos, y quizás ni siquiera sea necesario, dado el número relativamente bajo de quejas que se reciben. Por otro lado, los chatbots conversacionales mejorados con IA podrían ser de utilidad para estos mecanismos guiando a las personas afectadas a las secciones correspondientes de los sitios web, ya sea para presentar una reclamación o para obtener información sobre casos específicos.

La capacidad de síntesis de la IA también está mejorando con rapidez, como lo demuestran recientes investigaciones que sugieren que los evaluadores humanos preferían los resúmenes generados por IA que los creados por personas en más de un 50 % de los casos. Combinados con traducciones multilingües y visualizaciones instantáneas generadas por IA que simplifican los datos complejos para las personas sin formación especializada, los resúmenes pueden ayudar a los miembros de la comunidad a acceder a los contenidos de los documentos técnicos que producen los mecanismos independientes de rendición de cuentas. A su vez, los funcionarios que forman parte de estos mecanismos pueden valerse de la IA para sintetizar las notas y las grabaciones de audio que registran durante las visitas de campo. Se trata de herramientas que podrían reducir significativamente el tiempo y el esfuerzo utilizados y promover la transparencia y la accesibilidad. Con todo, es recomendable tener cautela al usar las tecnologías desarrolladas en el hemisferio norte, para las que podría ser difícil reflejar la complejidad de las dinámicas sociales que caracterizan a los diversos casos.

Megumi Tsutsui, investigadora asociada sénior de Accountability Counsel (i), reconoció los desafíos en materia de datos que implica el uso de la IA para definir riesgos y preocupaciones ambientales, sociales y de gobernanza, como comenzó a hacerse con la herramienta de análisis basada en aprendizaje automático MALENA (i), de la Corporación Financiera Internacional. No obstante, su esperanza es que la IA “redunde en ahorros de tiempo y de costos y en una eficiencia que brinde un mayor margen para llevar a cabo una debida diligencia más seria y obtener más información de las personas sobre el terreno, que son las principales afectadas por estos grandes proyectos”.

Un aspecto importante de esta debida diligencia adicional es velar por que los datos utilizados sean confiables y asegurarse de que no resten importancia a las preocupaciones de la comunidad. “Las personas más afectadas por muchos de estos proyectos no están generando datos que serían captados por un modelo de IA”, señaló Tsutsui. “Por eso, es necesario asegurarse de verificar los comentarios formulados por las comunidades. Sus voces tienen que escucharse de alguna manera”.

El poder de análisis de la IA puede hacerse notar en conjuntos de datos de mayor volumen y calidad. Tsutsui explicó que Accountability Counsel hace un seguimiento de la labor de los mecanismos independientes de rendición de cuentas en comunidades de todo el mundo, y que está abordando la IA con una precaución justificada. Sin embargo, la organización ya tiene previsto utilizar esta tecnología en Accountability Console (i), la base de datos de alrededor de 1800 reclamaciones que gestiona Accountability Counsel, y en la actividad para establecer los valores de referencia en los que se basan los informes emblemáticos sobre las políticas de los mecanismos independientes de rendición de cuentas, como el Good Policy Paper. “Las tareas de comparación y generación de valores de referencia son procesos esencialmente manuales”, dijo Tsutsui. “Nuestra expectativa es que la IA nos permita realizarlas mucho más rápido. Eso nos permitirá dedicar más tiempo al análisis”.

En un blog (i) de la Práctica Global de Desarrollo Digital del Banco Mundial se define la toma de decisiones como un proceso que implica “predecir los resultados y decidir qué medidas adoptar”. Un aspecto clave de la IA es que desvincula las predicciones de las decisiones. En última instancia, la facultad decisoria sigue perteneciendo a los humanos. Si la IA mejora sus predicciones, entonces los seres humanos podrán tomar mejores decisiones. En palabras de Alexandra Todericiu, oficial de Tecnologías de la Información del Laboratorio de Tecnología e Innovación: “Todo el mundo teme que la IA nos reemplace. En realidad, la conversación debería girar en torno a cómo la IA puede ayudarnos a ser más eficientes”.

Equilibrar las expectativas y los temores mediante la gobernanza

Desde 2018, el Grupo Banco Mundial ha iniciado alrededor de 45 proyectos vinculados con la IA, entre ellos innovaciones como MALENA y Mai, el chatbot seguro del Banco basado en inteligencia artificial, y está en estudio un marco de gestión de la IA. Muchas instituciones internacionales y Gobiernos han redactado normas sobre la IA, entre ellos Estados Unidos, China, las Naciones Unidas y la Unión Europea. Si bien sus objetivos generales se asemejan, en el sentido de que buscan velar por un uso responsable y ético de la IA, que respete los derechos humanos y reduzca los riesgos y los daños, los enfoques varían ampliamente, y van desde normas “blandas” hasta leyes “duras”, e incluso la “autorregulación”, un modelo en que la responsabilidad recae en la propia industria de la IA.

Algunos piensan que lo que estamos haciendo no alcanza. Michael Møller, miembro del Directorio de la fundación Geneva Science and Diplomacy Anticipator (GESDA) y exvicesecretario general de las Naciones Unidas, dijo: “Casi todos están tratando de alcanzar un caballo que ya se ha desbocado. La IA como la conocemos hoy es un juego de niños frente a lo que se nos aproxima a una velocidad imparable. No hemos dedicado suficiente tiempo para reflexionar ni hemos adoptado las medidas necesarias para abordar las tecnologías del futuro: los aspectos referidos a la gobernanza, la ética, la equidad, la rendición de cuentas y la transparencia, entre otros, deben incorporarse a las tecnologías de la IA antes de que salgan de los laboratorios y las universidades. En la actualidad, hay que ponerse al día en términos de las directrices sobre cómo regular la IA. El problema es que no existe coordinación, y todos están trabajando por su lado. Lo que en realidad necesitamos es un conjunto de normas mundiales y flexibles que reciban el apoyo de todos”.

En una visita que realizó en febrero de 2024 a Silicon Valley (California), Volker Türk, el alto comisionado de las Naciones Unidas para los Derechos Humanos, se hizo eco del pedido de Møller de una “innovación supervisada” de la IA. Criticó a los desarrolladores por carecer de una “perspectiva global del mundo” y llamó a la industria tecnológica a cumplir con los Principios Rectores sobre las Empresas y los Derechos Humanos de las Naciones Unidas (PDF, en inglés): “Necesitamos que las empresas actúen con responsabilidad. Necesitamos que exista rendición de cuentas por los daños. Necesitamos que las víctimas de esos daños tengan acceso a medidas correctivas. Pero por sobre todas las cosas, para reducir las probabilidades de que esos daños siquiera ocurran, necesitamos una gobernanza sólida de la IA, que se base firmemente en los derechos humanos”.

Quizás lo único que necesitamos es comunicarnos más entre nosotros. Møller explicó de qué manera GESDA facilita los intercambios: “Convocamos a científicos y no científicos, dos grupos que en realidad nunca se han comunicado demasiado, para que puedan entenderse mejor. No se trata solo de una conversación: es una manera de conformar grupos de trabajo en los que participen científicos y no científicos. Y estas conversaciones han dejado su huella en muchos de los principales científicos, que súbitamente han caído en la cuenta de que es necesario incorporar la dimensión de los posibles impactos sobre la sociedad de las cosas en las que están trabajando”.

Khuram Farooq, especialista sénior en gobernanza del Banco Mundial, sintetizó acertadamente el desafío que entraña el uso responsable de la IA en el sector del desarrollo: “A menudo las personas primero inventan una tecnología, y luego intentan adaptarla a los problemas del mundo real. Pero la tecnología nunca debería ser lo primero. Si alguien quiere obtener una licencia de conducir, no le importa si para eso se necesita la IA o es solo un pedazo de papel; lo que quiere es que le entreguen el documento sin demoras. Lo primero es el problema, y luego se ve si la IA puede ayudar”. Cuando se acerca la fecha de la Cumbre Mundial “AI for Good” (i) de las Naciones Unidas, el eslogan “Conectar a los innovadores del campo de la IA con los responsables de los problemas para resolver los desafíos mundiales” nunca había sido tan oportuno.